OpenAI vient de frapper un grand coup dans le monde de l’intelligence artificielle avec l’annonce de GPT-4o, son nouveau modèle phare. Le « o » signifie « omni », et pour cause : ce modèle révolutionnaire est capable de raisonner simultanément à travers le texte, l’audio et la vision en temps réel. Une véritable prouesse technologique qui promet de transformer notre interaction avec les machines.

Des Capacités Multimodales Impressionnantes

GPT-4o se distingue par sa polyvalence inédite. Il peut accepter en entrée n’importe quelle combinaison de texte, audio, image et vidéo, pour générer en sortie du texte, de l’audio ou des images. Sa réactivité est stupéfiante, avec des temps de réponse aux entrées audio aussi bas que 232 millisecondes, rivalisant avec la vitesse de réaction humaine dans une conversation.

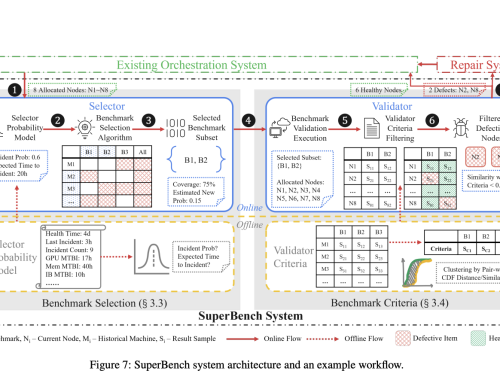

Performance et Efficacité

Ce nouveau modèle n’est pas qu’une simple évolution, c’est une véritable révolution. Il égale les performances de GPT-4 Turbo sur le texte en anglais et le code, tout en offrant des améliorations significatives pour les langues non-anglophones. De plus, GPT-4o se montre particulièrement doué pour la compréhension visuelle et audio, surpassant les modèles existants dans ces domaines.

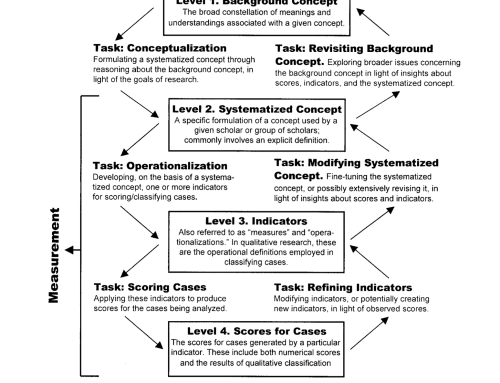

Une Approche Intégrée Révolutionnaire

Contrairement aux versions précédentes qui utilisaient plusieurs modèles en cascade, GPT-4o a été entraîné de bout en bout sur toutes les modalités (texte, vision, audio). Cette approche unifiée permet au modèle de conserver toute la richesse des informations d’entrée, qu’il s’agisse du ton de la voix, de la présence de plusieurs interlocuteurs ou des bruits de fond.

Des Applications Concrètes Fascinantes

Les démonstrations d’OpenAI donnent un aperçu des possibilités offertes par GPT-4o :

- Traduction en temps réel

- Assistance visuelle pour l’apprentissage des langues

- Interaction vocale naturelle

- Analyse d’images et de vidéos

On peut imaginer GPT-4o comme un ninja de l’IA, capable de se faufiler habilement entre les différentes modalités de communication pour accomplir sa mission avec précision et rapidité.

Disponibilité et Accès

OpenAI déploie progressivement les capacités de GPT-4o. Les fonctionnalités de texte et d’image sont déjà disponibles dans ChatGPT, y compris pour les utilisateurs gratuits (avec des limites plus élevées pour les abonnés Plus). Les développeurs peuvent également accéder à GPT-4o via l’API, bénéficiant d’une vitesse doublée et d’un coût réduit de moitié par rapport à GPT-4 Turbo.

Sécurité et Limitations

OpenAI a intégré des mesures de sécurité dès la conception de GPT-4o, notamment par le filtrage des données d’entraînement et l’affinement du comportement du modèle. Des évaluations approfondies ont été menées, y compris des tests externes par plus de 70 experts, pour identifier et atténuer les risques potentiels.

Malgré ces avancées impressionnantes, GPT-4o présente encore certaines limitations, notamment dans la gestion de tâches complexes impliquant plusieurs étapes ou dans la compréhension de contextes très spécifiques.

Conclusion

GPT-4o marque une étape majeure dans l’évolution de l’intelligence artificielle. En combinant text, vision et audio dans un seul modèle performant, OpenAI ouvre la voie à des interactions homme-machine plus naturelles et intuitives. Reste à voir comment cette technologie sera adoptée et quelles innovations elle inspirera dans les mois à venir.

Pour plus d’informations sur GPT-4o et ses capacités, vous pouvez consulter l’annonce officielle d’OpenAI.